Lorsqu’elle tombe entre de mauvaises mains, la technologie peut parfois servir la cause d’individus malveillants, tels que les fraudeurs. Mais guidée par de bonnes intentions, elle permet à l’inverse d’agir pour prévenir la fraude, grâce à divers outils d’analyse relevant de l’intelligence artificielle (IA).

Des pertes de 2 % pour l’industrie

« La fraude est une considération majeure dans l’industrie des télécommunications, relate le Dr Gadi Solotorevsky, directeur technique chez Amdocs cVidya, fournisseur de solutions d’IA. Aujourd’hui, près de 2 % ou plus de 1 500 milliards de dollars de revenus annuels mondiaux sont perdus chaque année en raison d’un comportement frauduleux. Les pertes totales dans l’industrie sont stupéfiantes », souligne-t-il.

« Aujourd’hui, près de 2 % ou plus de 1 500 milliards de dollars de revenus annuels mondiaux sont perdus chaque année en raison d’un comportement frauduleux. »

– Gadi Solotorevsky, directeur technique chez Amdocs cVidya

Les tentatives les plus courantes constituent des fraudes aux paiements et aux abonnements, des vols d’identité, des prises de contrôle de compte, des menaces d’initiés et des échanges de cartes SIM. « Nous rencontrons également toujours des scénarios de fraude traditionnels basés sur l’utilisation, tels que le piratage PBX ou IP-PBX, les schémas de rappel et l’abus de réseaux et d’appareils faibles. »

Grâce au principe de l’apprentissage machine, l’IA peut détecter des comportements inhabituels et reconnaître un acte frauduleux. C’est sur ce système que reposent les mécanismes que développe Amdocs cVidya, auxquels Bell Canada a d’ailleurs recours pour détecter les tentatives de fraude ciblant sa clientèle.

« Le système apprend et réagit immédiatement à ces changements en créant des modèles de réponse », explique le Dr Solotoresvsky. Il ajoute que l’adaptabilité de l’IA est « cruciale » car les schémas de fraude sont en constante évolution. « Ils changent car une fois que les fraudeurs identifient que leurs méthodes et stratégies sont détectées, ils les modifient. En appliquant une IA auto-adaptative avec l’apprentissage automatique, les entreprises sont en mesure de détecter et de s’adapter rapidement à ces schémas de fraude en constante évolution. »

L’arroseur arrosé

L’échange de courriels est le moyen préféré des fraudeurs pour tendre des pièges. Bien que la plupart de leurs destinataires sachent reconnaître une tentative de hameçonnage, il suffit de quelques répondants moins avisés pour rentabiliser les milliers de courriels envoyés par leur expéditeur. Pour déjouer les fraudeurs qui s’y prenaient de la sorte, une organisation néo-zélandaise du nom de Netsafe avait lancé, en 2017, « Re:scam », un agent conversationnel (chatbot), à qui les victimes pouvaient dénoncer une tentative de fraude et envoyer les courriels reçus.

Grâce à l’IA, Re:scam adoptait alors le comportement de quelqu’un qui aurait mordu à l’hameçon, en répondant à son tour aux courriels frauduleux, tentant d’« arnaquer les arnaqueurs ». Pour que ces derniers n’y voient que du feu, l’agent conversationnel prenait le soin d’inclure, dans sa correspondance, quelques erreurs, et même quelques blagues ici et là, histoire de paraître authentique. « Le but étant de correspondre avec le fraudeur le plus longtemps possible afin de lui faire perdre du temps, perturber ses activités et lui coûter en profits », indiquait Netsafe.

Malheureusement pour sa communauté, après plus d’un million d’emails frauduleux reçus en cinq ans, Re:scam a récemment cessé ses activités. Sont retour étant réclamé, le développeur n’a pas exclu de relancer l’outil pour continuer ses bonnes œuvres. En attendant, d’autres s’en inspirent pour développer leur propre chatbot anti-fraude.

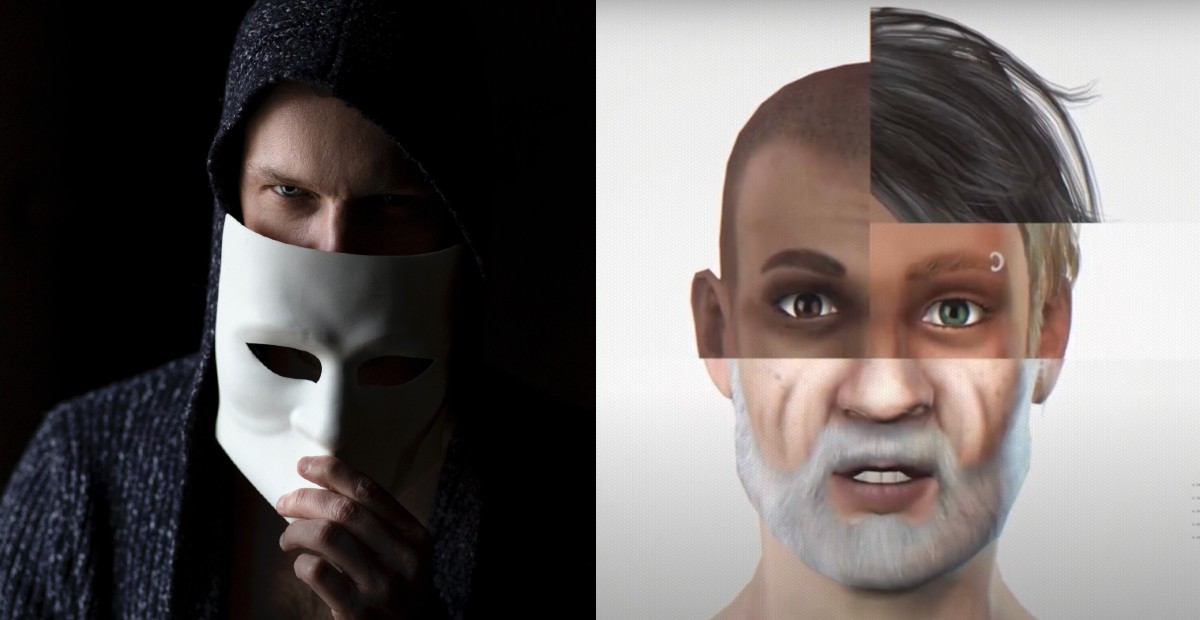

Les deux faces d’une même pièce

À double tranchant, l’IA a aussi facilité, depuis les dernières années, la création de faux profils sur les réseaux sociaux, permettant à des fraudeurs de se faire passer pour des personnes célibataires ou amicales, en quête d’une relation. Derrière un profil monté à partir de visuels et de textes générés grâce à l’IA, ces fraudeurs établissent un lien de confiance, et partent à la pêche aux informations personnelles afin de quémander naturellement de l’argent ou encore faire du chantage.

La Sûreté du Québec (SQ) indique qu’en 2019, l’arnaque amoureuse occupait le premier rang des arnaques chez les aînés au Québec, causant des pertes monétaires évaluées à 2,1 M$. « Le fraudeur crée de faux profils sur des sites de réseautage social ou de rencontres en ligne, et démontre un intérêt à développer une relation sérieuse. Il essaie de soutirer de l’argent par différents stratagèmes. »

Il y a quelques années, il était encore possible de dissiper le doute, en tentant de retracer la provenance d’une photo afin de l’associer à son auteur original. Pour cela, il suffisait de faire une recherche d’image inversée en se rendant sur images.google, afin de trouver toutes ses parutions sur le web. Très vite, on pouvait alors en connaître la source, et identifier le compte de l’usurpateur comme étant frauduleux.

Or de nos jours, un imposteur n’a plus besoin de piquer des photos déjà existantes pour créer un faux profil. Il n’a qu’à s’en remettre à des applications et sites internet gratuits, qui se servent de l’IA pour générer la photo d’un homme ou d’une femme aux traits tout à fait humains et réalistes. Pensons aux portraits que permet de créer le développeur Nvidia grâce à la méthode StyleGAN. À partir de photos de vraies personnes, le programme croise dans un premier temps différents visages pour en créer de nouveaux, complètement artificiels. Dans un deuxième temps, il en assure la cohérence et s’assure du degré de réalisme. Le processus est notamment utilisé dans l’industrie du jeu vidéo pour la création de personnages. « Un jour, il sera difficile de faire la différence entre un être créé artificiellement et un vrai être humain », a d’ailleurs mentionné, dans une récente entrevue avec CScience IA, le fondateur et président directeur-général de Yulism, Stéphane Martel, également cofondateur du regroupement Entertainment-AI.

En attendant, l’éditeur de logiciels V7 Labs a créé une nouvelle extension Google Chrome, le « Fake Profile Detector ». L’outil serait capable, ironiquement, de détecter grâce à l’IA les fausses photos de profil créées à l’aide de l’IA. Si l’éditeur en évalue à 99,28 % le taux de précision, il explique que l’extension ne fonctionne toutefois qu’avec les images StyleGAN, et non pas les transformations de visage et les deepfakes vidéo.

Sur le thème de la fraude et de la cybersécurité :

- Article du 30 juin 2022 : PME : votre entreprise est-elle à l’abri des cyberattaques ?

- Article du 14 juin 2022 : 35 % des Québécois utilisent la reconnaissance faciale pour s’authentifier

- Article du 9 avril 2021 : Cybersécurité : quand l’IA joue au shérif

Crédit Image à la Une : Sander Sammy et Netsafe

![[Tournage d’un C+Clair] « Comment le génie révolutionne-t-il le sport ? » : Réservez votre place!](https://www.cscience.ca/wp-content/uploads/2024/03/emission-speciale-cclair-genium3-480x362.png)

![[Émission C+Clair] Maladies rares : comment optimiser les efforts de la recherche ?](https://www.cscience.ca/wp-content/uploads/2024/04/emission-maladies-rares3-480x362.jpg)